Face aux risques d’addiction, de désinformation et de harcèlement, Bulle défend une réponse centrée sur l’architecture même des plateformes sociales.

Alors que plusieurs États veulent interdire les réseaux sociaux aux moins de 15 ans, Bulle avance une autre voie : modifier les mécanismes qui organisent l’attention, la visibilité et la circulation des contenus. Le réseau social européen estime que la vérification de l’âge ne suffit pas si les publications dangereuses restent accessibles, amplifiées ou recommandées par des algorithmes peu lisibles. Sa proposition repose sur trois leviers : transparence algorithmique, limitation du temps d’usage et cadre éditorial strict. L’enjeu dépasse la protection des mineurs : il touche à la sécurité informationnelle et à la responsabilité des plateformes numériques.

Une réponse au-delà du contrôle d’âge

La protection des mineurs en ligne s’impose désormais comme un sujet politique central. En France, en Turquie, en Espagne, en Grèce ou en Norvège, des textes ont été adoptés ou préparés pour encadrer plus fermement l’accès des jeunes aux réseaux sociaux. Cette dynamique dépasse l’Europe. L’Australie a instauré, depuis fin 2025, une limite d’âge fixée à 16 ans. Selon les premiers bilans cités, cette mesure n’a pas modifié de façon notable la domination des grandes plateformes. ZATAZ explique même que dès l’annonce de ces nouvelles régles, les pirates proposaient à la vente des comptes et des accès afin de passer outre les restriction !

Ces initiatives traduisent une même inquiétude : l’exposition des adolescents à des contenus violents, trompeurs ou addictifs. Elles reposent pourtant sur une logique principalement défensive. Il s’agit de filtrer l’entrée, de vérifier l’âge, puis d’autoriser ou de bloquer l’accès. Cette approche laisse intact le cœur du problème. Une plateforme peut contrôler l’âge de ses utilisateurs tout en conservant des systèmes de recommandation opaques, capables de pousser des contenus anxiogènes, polarisants ou trompeurs.

Un réseau social n’est pas seulement un espace d’expression. C’est aussi une infrastructure de visibilité, où chaque signal, chaque interaction et chaque recommandation peut orienter l’attention collective. Lorsque les règles internes restent invisibles, les utilisateurs ne savent pas pourquoi certains contenus leur sont montrés, ni comment certaines publications gagnent en puissance.

Bulle affirme donc que la réponse ne peut pas se limiter à l’interdiction. Le réseau social européen propose de déplacer le débat vers la conception même des outils numériques. L’objectif consiste à réduire les risques avant qu’ils ne deviennent structurels : dépendance aux flux, exposition répétée à des contenus toxiques, propagation de rumeurs ou pression sociale permanente.

La plateforme agit d’abord sur le temps d’usage. Par défaut, chaque utilisateur dispose d’une limite quotidienne d’une heure trente. Ce choix vise à casser la logique de captation continue, souvent centrale dans les modèles d’engagement. Un couvre-feu nocturne est appliqué. Il bloque automatiquement l’accès pendant la nuit. Cette mesure s’inscrit dans une approche de réduction des risques, plutôt que dans une exclusion totale des jeunes publics.

Le principe est clair : limiter l’emprise sans supprimer les usages. Les adolescents, les créateurs, les journalistes et les médias peuvent continuer à utiliser des formats sociaux attractifs, mais dans un cadre moins dépendant de la stimulation permanente. Le sujet n’est plus seulement l’âge biologique de l’utilisateur. Il devient la qualité de l’environnement numérique dans lequel cet utilisateur évolue.

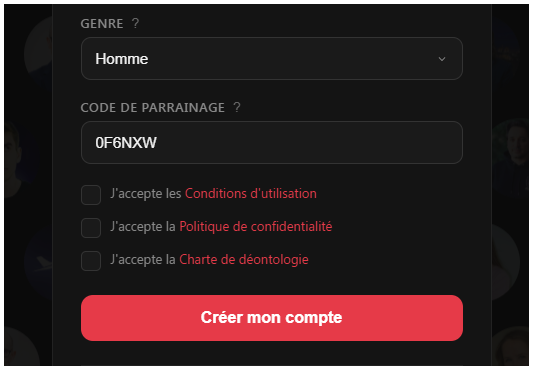

Envie de tester ? Cette proposition n’est pas un partenariat ou toutes autres démarches commerciales. Juste vous permettre de découvrir un projet qui nous semble prometteur et respectueux de l’Internet et des Internautes ! Voici comment faire : www.bulle.media. Lors de votre inscription, utilisez le code parrainage : 0F6NXW

Des algorithmes publics pour une information lisible

Le deuxième pilier de Bulle concerne la transparence algorithmique. La plateforme indique que ses algorithmes de recommandation sont publics et consultables. Cette orientation tranche avec le fonctionnement dominant des grands réseaux sociaux, où les critères de diffusion restent souvent difficiles à comprendre. Cette lisibilité compte : elle permet d’observer les mécanismes qui hiérarchisent l’information, favorisent certains contenus et organisent la visibilité.

Rendre un algorithme consultable ne supprime pas tous les risques. Mais cela modifie le rapport de force entre la plateforme, les producteurs de contenus et les utilisateurs. Les règles ne sont plus seulement imposées dans une boîte noire. Elles deviennent discutables, vérifiables et potentiellement contrôlables. Pour les médias et les journalistes, cette transparence peut aussi renforcer la confiance dans les conditions de diffusion.

Bulle associe cette transparence à une charte de déontologie stricte. Les publications doivent respecter des règles explicites, pensées pour limiter la désinformation et les dérives. Cette dimension éditoriale donne à la plateforme une identité particulière : elle ne se présente pas uniquement comme un outil social, mais comme un espace structuré pour l’information et la création. Les contenus y circulent dans un cadre défini, où la responsabilité des auteurs est placée au centre.

Cette organisation répond à une demande croissante : disposer de formats numériques attrayants, sans abandonner les exigences de fiabilité. Les créateurs peuvent publier, les médias peuvent diffuser, les journalistes peuvent toucher leurs publics, mais dans un environnement où les règles de visibilité et de publication sont affichées. Le modèle revendiqué cherche donc un équilibre entre attractivité, responsabilité et sécurité informationnelle.

Clément Étoré, fondateur de Bulle, résume cette logique en opposant la restriction d’accès à la transformation des mécanismes internes. Selon lui, les réponses actuelles s’appuient surtout sur l’interdiction ou la vérification de l’âge, sans changer les logiques profondes des plateformes. Il souligne que ces logiques déterminent la circulation des contenus et la captation de l’attention. Sur Bulle, explique-t-il, les algorithmes sont publics, l’usage est limité par défaut et une charte de déontologie encadre les publications. L’objectif annoncé est de réduire les risques d’addiction et de désinformation, tout en conservant des formats adaptés aux jeunes, aux créateurs et aux médias.

Dans cette bataille, l’enjeu n’est plus seulement de bloquer l’accès, mais de rendre visibles les mécanismes qui gouvernent l’information.